Bias na IA: o que acontece quando só homens treinam os algoritmos?

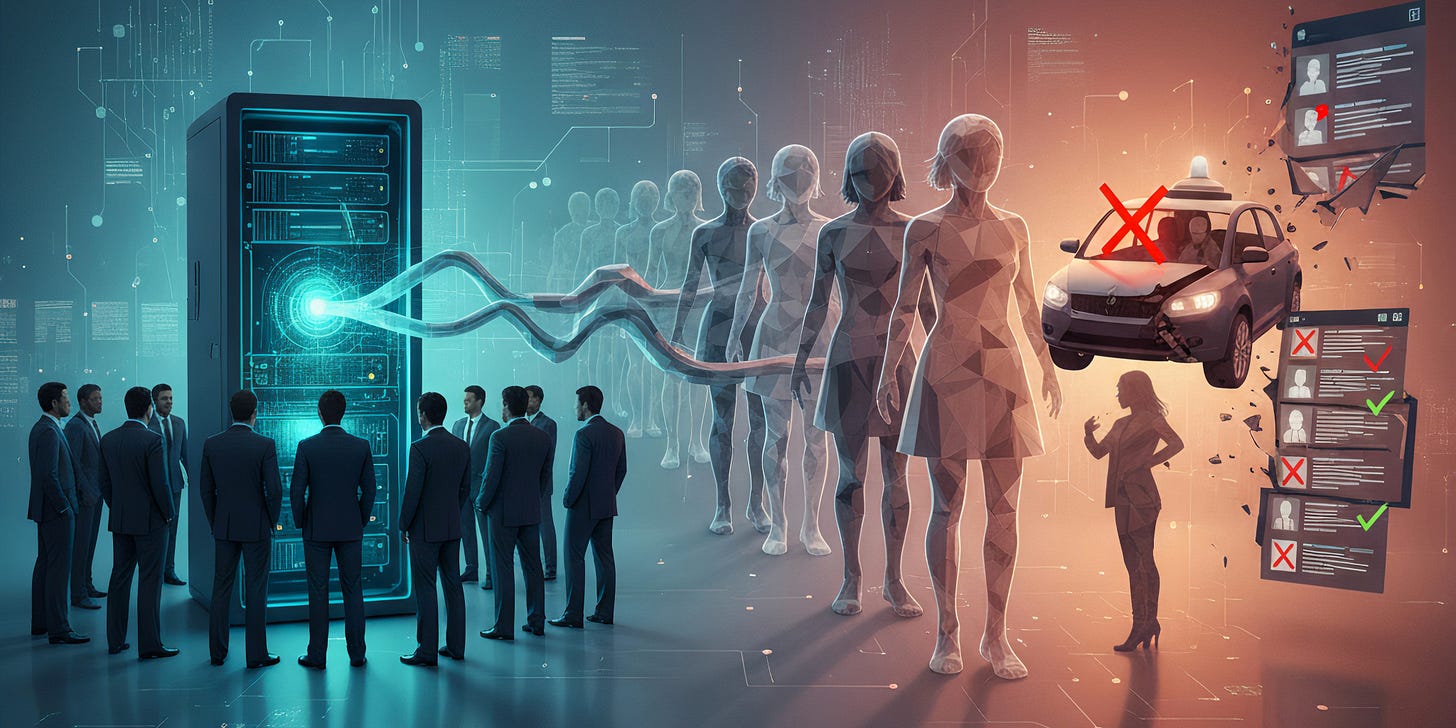

E se o próximo carro autônomo ou sistema de recrutamento “decidir” que você não é o padrão - simplesmente porque foi treinado por homens?

Imagine comprar um carro “seguro” e descobrir que ele nunca foi testado em corpos como o seu. Foi o que aconteceu com milhares de mulheres nos anos 80. Nessa época surgiram os primeiros carros que ofereciam airbags como dispositivo de segurança. Essa invenção revolucionou o mundo automotivo, mas teve impactos diferentes entre homens e mulheres. Embora o equipamento ajudasse a salvar vidas, ele não havia sido criado considerando as diferenças de altura, peso e estrutura corporal entre homens e mulheres.

Os primeiros manequins utilizados em testes eram baseados no homem médio, ou seja, ignoravam mulheres, crianças e pessoas de menor estatura. As mulheres, por serem menores e mais leves, frequentemente sentavam mais próximas do volante, colocando elas mais perto do ponto de explosão, aumentando o risco de lesões no rosto, pescoço e tórax.

Quando a IA aprende com poucos

Casos como esse são frequentes no desenvolvimento de tecnologias envolvendo inteligência artificial, quando quem cria os modelos de machine learning (aprendizado de máquina), são em sua maioria, homens. A falta de diversidade no desenvolvimento tecnológico está moldando aplicações de IA carregadas de vieses.

Chamamos de AI bias - viés de inteligência artificial - resultados gerados por aprendizado de máquina que refletem discriminação, preconceito e injustiça social. O artigo Algorithmic Governance: Gender in AI-Generated Policymaking? (Human-Centric Intelligent Systems, 2025) analisou como o viés de gênero pode afetar políticas públicas geradas por IA, mostrando que os algoritmos refletem as desigualdades estruturais presentes nos dados de treinamento.

O estudo mostra como modelos de linguagem generativa como o ChatGPT tendem a associar títulos como “doutor” ou “engenheiro” a homens mais do que a mulheres (vale lembrar que em inglês, esses termos são neutros). Ele também cita como exemplo a exclusão de currículos de mulheres em processos de emprego. A IA, por ser apresentada como neutra, é frequentemente aceita como imparcial e realista, quando na verdade, esconde as origens da sua desigualdade nos dados utilizados para alimentá-la.

A desigualdade que começa antes dos algoritmos

De acordo com um relatório da UNESCO, divulgado pela revista Physics Today (fev/2025), as mulheres continuam sub-representadas nas áreas de STEM, representando apenas 35% dos formados e 22% da força de trabalho da área nos países que formam o G20. Além disso, ganham menos que homens em áreas de ciência e tecnologia, chegando a apenas 69% do salário masculino dos EUA.

A desigualdade de gênero em STEM ainda persiste por vários motivos, entre eles: estereótipos, pressões sociais e preconceitos culturais. De acordo com o relatório, 34% das mulheres disseram que já enfrentaram sexismo, assédio ou violência de gênero como um dos principais desafios nessas áreas. Esse estudo ajuda a entender, ao longo do tempo, o que leva uma pessoa a escolher - ou desistir - de seguir carreira em ciência e tecnologia.

Diversidade é inovação (e lucro)

Apesar de ser vista apenas como pauta social, a diversidade dentro de uma empresa está relacionada à vantagem competitiva. Quando uma equipe homogênea treina um modelo de IA, ela irá reproduzir a visão de mundo daquele grupo, criando produtos enviesados, incapazes de compreender diferentes realidades. Em uma equipe diversa, as múltiplas perspectivas identificam vieses e constroem soluções mais inclusivas e rentáveis.

Um exemplo de como a diversidade influencia a tecnologia vem do Google Tradutor. Durante muito tempo, palavras neutras em idiomas como o Indonésio, eram transformadas em pronomes masculinos ou femininos, mesmo que não existisse a necessidade. Por exemplo:

“engenheiro” era traduzido como he (ele)

“enfermeiro” como she (ela)

A pesquisadora Tira Nur Fitria (2021), explica que isso acontece porque o sistema aprende com dados históricos da internet, refletindo preconceitos humanos. Ou seja, a IA herda os vieses de quem a treina.

A Google reconheceu o problema e lançou uma atualização do Google Tradutor que exibe traduções tanto no masculino quanto no feminino, na tentativa de corrigir esse viés e tornar o sistema mais inclusivo.

Quando empresas investem em diversidade e inclusão no desenvolvimento de suas tecnologias, elas melhoram a qualidade do produto e ampliam o público que conseguem atender. Nesse caso, a Google ofereceu traduções mais precisas e representativas para bilhões de usuários. Com isso, aumenta-se a confiança do público na marca e melhora-se a experiência do usuário, tornando o produto mais competitivo globalmente.

O futuro da IA precisa de todas as vozes

Empresas com uma equipe diversa possuem maiores chances de criarem produtos mais inteligentes, evitando não só prejuízos reputacionais, mas perda financeira e processos judiciais. É o resultado da pluralidade de ideias.

Se estamos confiantes que a IA será a revolução tecnológica que trará benefícios e mudanças na nossa sociedade, permitir que esse mundo seja criado por poucos fará com que poucos se beneficiem dessas tecnologias.

Gostou deste conteúdo? Compartilhe com alguém que ainda acredita que a IA é neutra.

Não há força mais poderosa do que uma mulher determinada a crescer. Vamos juntas! 🦋

Conecte-se com a gente e faça parte da comunidade:

Canal no Whatsapp • Instagram • Grupo de LinkedIn • Cursos Gratuitos • Doar

Sua sugestão pode virar conteúdo! Queremos te ouvir 😄